通义万相2.2开源!首创电影级美学控制系统

CBINEWS

责任编辑:邹大斌

电脑商情在线

时间:2025-07-29 11:04

阿里云 通义千问 大模型 开源

7月28日,阿里开源视频生成模型「通义万相Wan2.2」,此次共开源文生视频(Wan2.2-T2V-A14B)、图生视频(Wan2.2-I2V-A14B)和统一视频生成(Wan2.2-IT2V-5B)三款模型,其中文生视频模型和图生视频模型均为业界首个使用MoE架构的视频生成模型,总参数量为27B,激活参数14B;同时,首创电影美学控制系统,光影、色彩、构图、微表情等能力媲美专业电影水平。

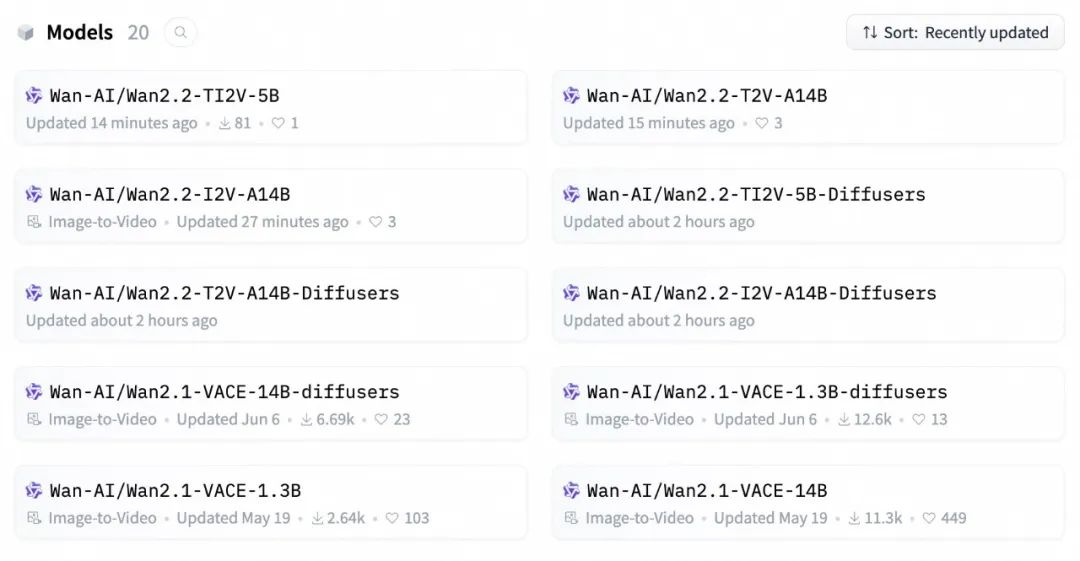

开发者可在GitHub、HuggingFace、魔搭社区下载模型和代码,企业可在阿里云百炼调用模型API,用户还可在通义万相官网和通义APP直接体验。

通义万相2.2率先在视频生成扩散模型中引入MoE架构,有效解决视频生成处理Token过长导致的计算资源消耗大问题。Wan2.2-T2V-A14B、Wan2.2-I2V-A14B两款模型均由高噪声专家模型和低噪专家模型组成,分别负责视频的整体布局和细节完善,在同参数规模下,可节省约50%的计算资源消耗,在模型能上,通义万相2.2在复杂运动生成、人物交互、美学表达、复杂运动等维度上也取得了显著提升。

Wan2.2还首创了「电影美学控制系统」,光影、色彩、构图、微表情等能力媲美专业电影水平。例如,用户输入「黄昏」、「柔光」、「边缘光」、「暖色调」「中心构图」等关键词,模型可自动生成金色的落日余晖的浪漫画面;使用「冷色调」、「硬光」、「平衡图」、「低角度」的组合,则可以生成接近科幻片的画面效果。

通义万相还开源了一款5B小尺寸的统一视频生成模型,单一模型同时支持文生视频和图生视频,可在消费级显卡部署。该模型采用了高压缩率3D VAE架构,时间与空间压缩比达到高达 4×16×16,信息压缩率提升至 64,均实现了开源模型的最高水平,仅需22G显存(单张消费级显卡)即可在数分钟内生成5秒高清视频,是目前24帧每秒、720P像素级的生成速度最快的基础模型。

自今年2月以来,通义万相已连续开源文生视频、图生视频、首尾帧生视频和全能编辑等多款模型,在开源社区的下载量已超500万,欢迎大家前往体验。